你一定听过这些说法:

“这台主机有10 TFLOPS!”

“手机算力爆表!”

“数据中心算力碾压一切!”

但问题是——

这些“算力”,到底在算什么?能直接比较吗?

这篇文章,我们不玩虚的,帮你彻底拆开

一、先把最核心的一句话讲明白

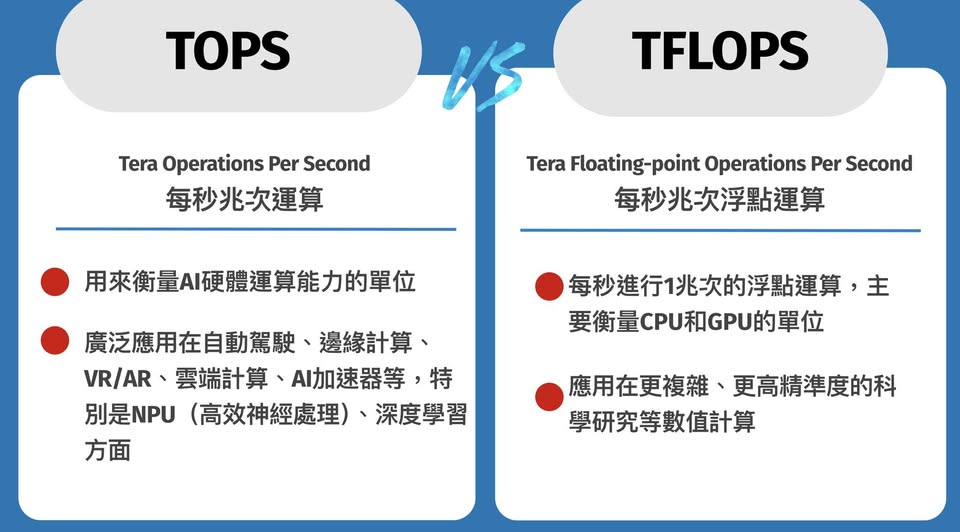

TFLOPS = 每秒能做多少“浮点运算”

更准确一点:

TFLOPS = Tera Floating Point Operations Per Second

Tera = 万亿(10¹²)

FLOP = 一次浮点计算(比如 1.2 + 3.4)

举个直观例子

假设一个GPU:

1 TFLOPS = 每秒能算 1万亿次小数计算

那:

10 TFLOPS = 每秒 10万亿次

听起来很猛对吧?

但——

这只是“理论速度”,不是实际表现

二、TFLOPS 是怎么“算出来”的?

核心公式其实很简单

算力 = 核心数量 × 频率 × 每周期运算次数

用GPU举例:

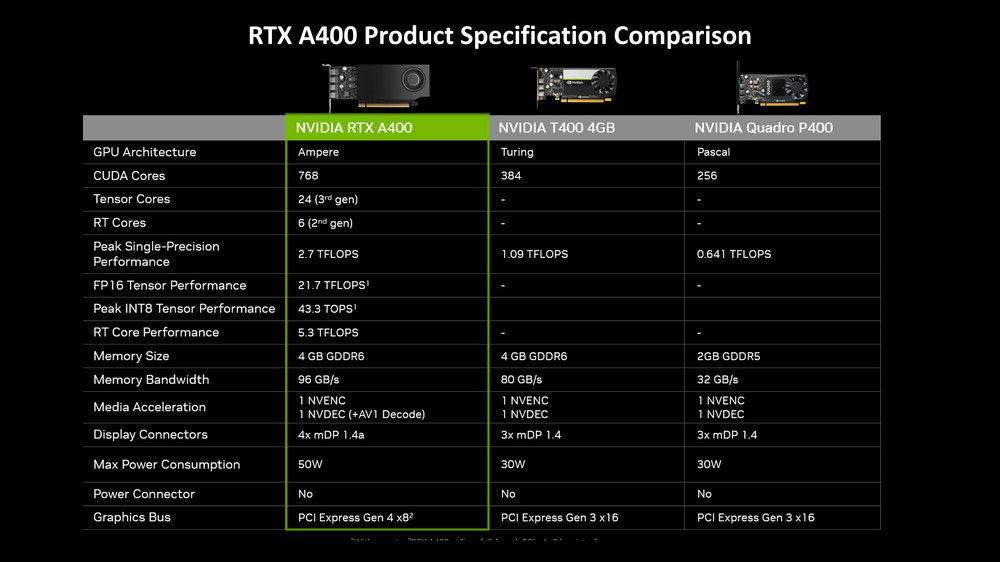

核心数(比如 2000个CUDA核心)

频率(比如 1.5GHz)

每个周期能做多少次浮点运算(通常是2次)

举个简化版:

2000 × 1.5GHz × 2 ≈ 6 TFLOPS为什么“+”经常出现?

你看到的“TFLOPS+”一般意味着:

不只是FP32算力,还包括:

FP16(半精度)

INT8(AI推理)

Tensor核心(AI专用)

换句话说:

“+” = 有额外加速能力(尤其是AI)

三、为什么同样TFLOPS,性能差很多?

这才是重点中的重点👇

TFLOPS ≠ 性能

原因有4个:

1️⃣ 架构差异

不同架构效率完全不同:

老架构:算力浪费严重

新架构:利用率更高

举个现实例子:

同样10 TFLOPS

新GPU可能比旧GPU快30%+

2️⃣ 带宽限制(内存速度)

算力再高:

数据拿不到 = 白搭

类似:

CPU很聪明

但内存喂不饱

3️⃣ 指令效率(每次算的复杂度)

有的架构:

一次运算能做更多事

4️⃣ 软件优化(游戏/系统)

同一硬件:

优化好 → 飞

优化差 → 拉

四、不同设备的“算力”有什么区别?

我们直接横向对比

游戏机(专用算力)

比如:

PlayStation 5

Xbox

特点:

专门跑游戏

算力利用率极高

优化极致

同TFLOPS,比PC更能打

电脑(通用算力)

比如:

显卡(RTX系列)

CPU

特点:

通用性强

但资源分散

效率取决于软件

手机(能效优先)

特点:

功耗极低

算力有限但优化极强

关键不是算力,而是:

每瓦性能(Performance per Watt)

五、算力真正的意义是什么?

算力 = 能同时处理多少复杂计算

在游戏里

算力决定:

分辨率(1080P / 4K)

帧率(30 / 60 / 120)

特效(光追、阴影)

在AI里

算力决定:

模型大小

推理速度

在视频/渲染

算力决定:

渲染时间

特效复杂度

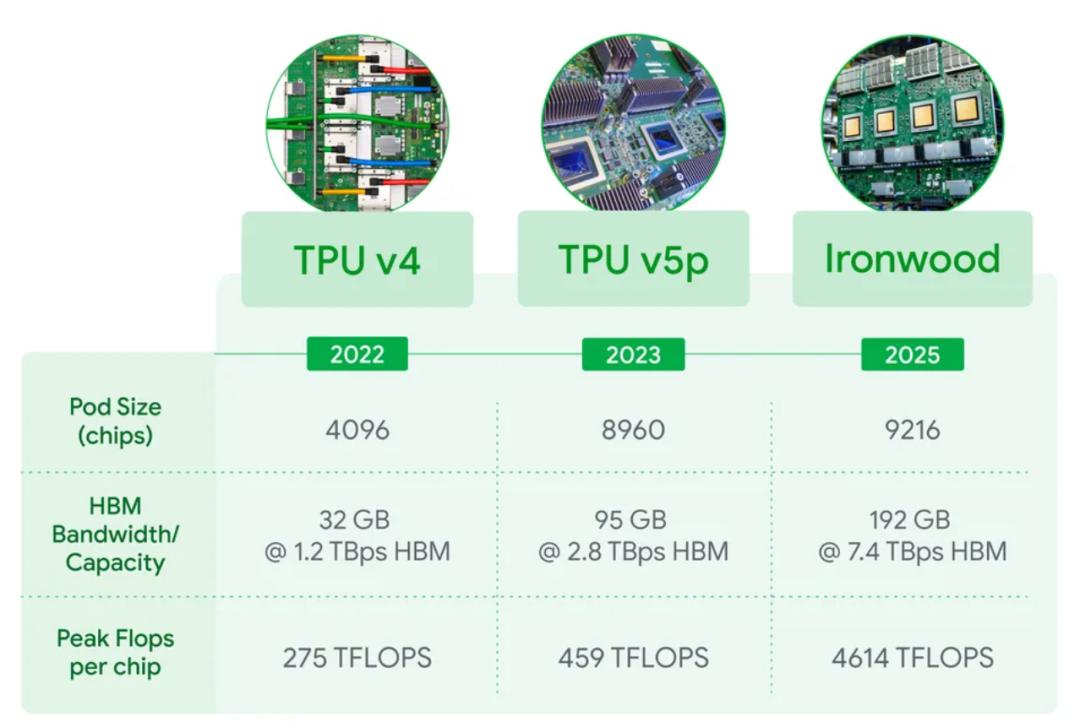

六、和“数据中心算力”有什么区别?

这是很多人容易混淆的

数据中心算力(完全不同维度)

比如:

超算

AI训练集群

单位通常是:

PFLOPS / EFLOPS

(百万亿 / 百亿亿)

对比一下就明白了

差距:

几千倍到几万倍

但重点来了

它们不能直接对比

原因:

游戏:实时渲染

数据中心:批量计算

类似:

跑车 vs 火车

都快,但用途完全不同

七、一个容易踩的坑

不要只看TFLOPS买设备

你应该看的是:

实际游戏帧率

实测性能

优化情况

TFLOPS只是“算力标称值”,不是体验保证

真正决定性能的是:

架构 + 带宽 + 优化 + 使用场景

算力就像马力,但不是车速

你买车不会只看马力——

买设备也一样。